卷积操作的维度计算是定义神经网络结构的重要问题,在使用如PyTorch、Tensorflow等深度学习框架搭建神经网络的时候,对每一层输入的维度和输出的维度都必须计算准确,否则容易出错,这里将详细说明相关的维度计算。

一、卷积操作的维度计算

卷积操作的维度计算是定义神经网络结构的重要问题,在使用如PyTorch、Tensorflow等深度学习框架搭建神经网络的时候,对每一层输入的维度和输出的维度都必须计算准确,否则容易出错,这里将详细说明相关的维度计算。

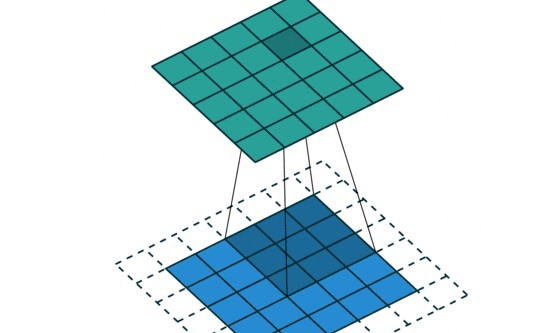

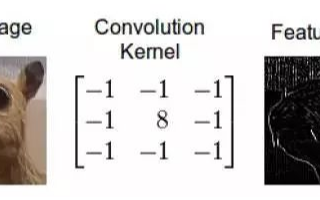

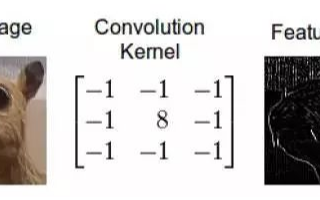

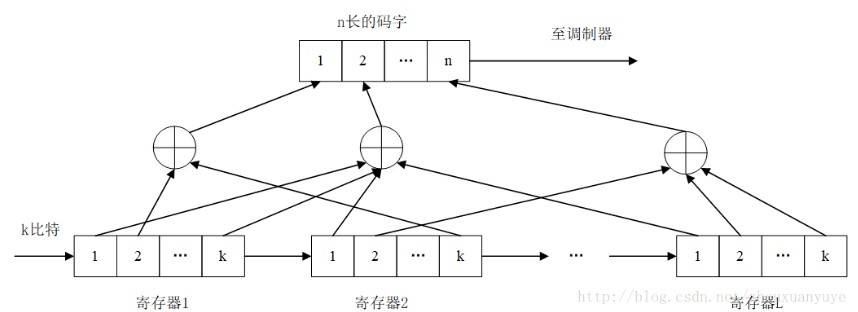

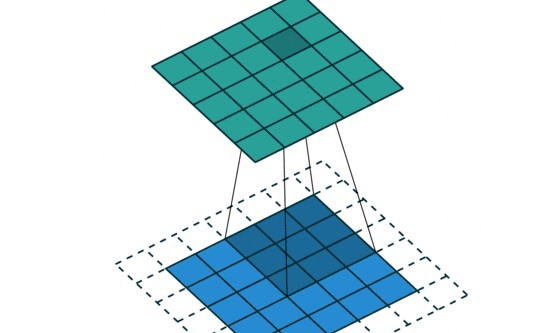

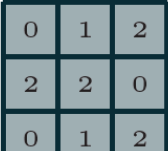

首先,我们看一下卷积操作涉及的东西,一个卷积操作需要定义卷积核的大小、输入图像的padding长度以及卷积操作的步长。以一个RGB图像输入为例,一个多卷积核操作的示意图如下:

使用两个卷积核扫描输入图像

这个例子的输入数据是一个三维数据,带有通道数,输入数据第三个维度是通道数,使用了两个卷积核(滤波器)扫描得到一个带有两个通道的图像(一个卷积核对一个三维的数据,即带多个通道的二维图像扫描可以得到一个二维单通道图像结果,要求卷积核也是三维,且通道数和输入数据通道数一样)。下面我们来描述具体计算。

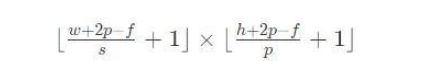

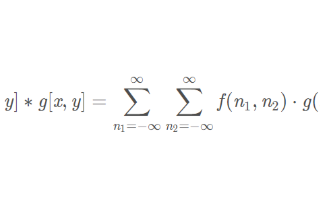

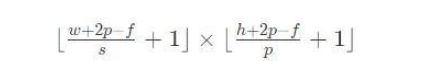

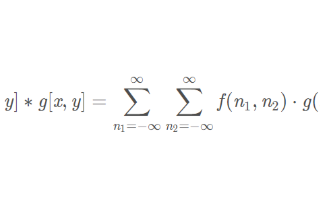

假设输入数据大小是w × h,其中,w是宽度,h是高度。扫描的卷积核大小是f × f。padding的长度是p(padding),步长是s(stride)。那么经过卷积操作之后,输出的数据大小:

如果输入的数据是三维数据,即:w × h × c。其中,w是宽度,h是高度,c是通道数(对于RGB图像输入来说,这个值一般是3,在文本处理中,通常是不同embedding模型的个数,如采用腾讯训练的、谷歌训练的等)。这个时候的卷积核通常也是带通道的三维卷积核:f × f × c。

注意,一般来说,卷积核的通道数c和输入数据的通道数是一致的。因此,这个时候卷积之后的输出依然是一个二维数据,其大小为:

这里的维度做了向下取整,防止结果不是整数的情况。假如希望输出的也是带通道的结果,那么这时候就要使用多个卷积核来操作了,最终输出的数据维度是:

其中c'是卷积核的个数。

二、深度学习框架中Conv1d、Conv2d

在像PyTorch、Tensorflow中,都有类似Conv1d、Conv2d和Conv3d的操作。这也都和卷积操作的维度有关,里面的参数都要定义好。例如如下的卷积操作:

self.convs = nn.Sequential( nn.Conv1d(in_channels=32, out_channels=16, kernel_size=5, stride=1, padding=0), nn.BatchNorm1d(16), nn.ReLU(inplace=True) )

这里面的参数要定义好,否则容易出错。我们将分别介绍。

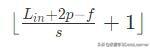

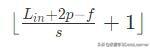

Conv1d是一维卷积操作,它要求输入的数据是三维的,即:N × C_in × L_in。

最终输出的参数也是三维的:N × C_out × L_out。

这里的N是mini batch size,C是通道数量,L是宽度。

这里的out_channels定义了将由几个卷积核来扫描,kernel_size则定义了每一个卷积核大小,都可以自己定义。最终,输出的min_batch_size不变,out_channels数量根据定义的参数来,而输出的width计算如下:

这里的p是上面padding的参数值,f是kernel_size的值。类似的,如果使用Conv2D做卷积操作,那么输入就是四维的:N × C_in × H_in × W_in。

这里的N是min batch size,C_in是输入数据的通道数,H_in是输入数据的高度,W_in是输入数据的宽度。其输出也是四维的,根据定义的卷积核大小和数量得到的输出维度如下:N × C_out × H_out × W_out。其中,C_out是根据卷积核的数量定义的输出数据的通道数,因为一个卷积核只能扫描得到一个二维图。其中H_out 和 W_out的计算如下:

三、总结

卷积操作的输入和输出数据的维度在构建神经网络中很重要,也很容易出错。使用PyTorch或者Tensoflow构建卷积神经网络的时候一定要注意参数的设置,如果计算错误,下一层的输入与上一层的输出对不上那么很有可能失败。为了避免这种情况发生,可以先用小数据集测试,同时为了检测哪里出错可以在测试的时候把每一层的输出结果的维度(shape)打印出来,这样就更容易检测结果了。

编辑:jq

相关推荐

转tensorflow到rknn过程中,经过残差结构时出现错误,图1为残差结构的op组成,图2为爆出的错误,根据错误推断出现在残差结构中的卷积层部分,经过权重处理后,在接下来的偏置项相加中维度对应不上出错,有相关开发经验的大佬可以分享下解决方法吗?

发表于 04-11 13:28

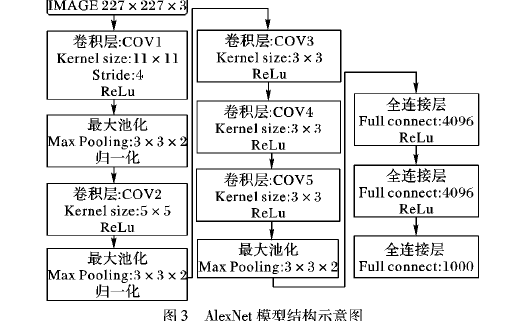

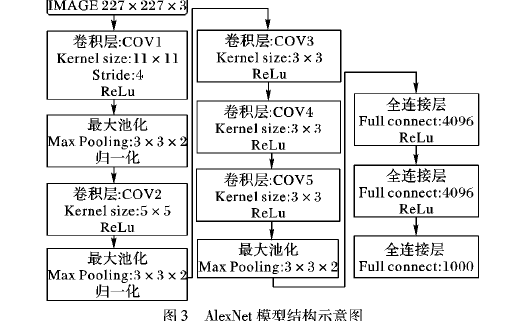

的结构出发进行创新,主要有简单的堆叠结构模 型,比如 ZFNet、VGGNet、MSRNet。堆叠结构模型通 过改进卷积神经的基本单元并将其堆叠以增加网络 的深度提升模型性能,但仅在深度这单一维度提升

发表于 08-02 10:39

卷积神经网络表征可视化研究综述(1)转载自:人工智能技术与咨询源自:自动化学报 作者:司念文 张文林 屈丹 罗向阳 常禾雨 牛铜摘要近年来, 深度学习在图像分类、目标检测及场景识别等任务上取得了

发表于 08-09 10:53

快速的部署到TI嵌入式平台。 TDA4拥有TI最新一代的深度学习加速模块C7x DSP与MMA矩阵乘法加速器,可以运行TIDL进行卷积等基本计算,从而快速地进行前向推理,得到计算结果。 当深度学习遇上

发表于 11-03 06:53

汽车安全系统的发展进步中发挥重要的作用。而这些系统远不止仅供典型消费者群体掌握和使用。深度学习这一概念在几十年前就已提出,但如今它与特定的应用程序、技术以及通用计算平台上的可用性能更密切相关。深度学习

发表于 11-11 07:55

列文章将只关注卷积神经网络 (CNN)。CNN的主要应用领域是输入数据中包含的对象的模式识别和分类。CNN是一种用于深度学习的人工神经网络。此类网络由一个输入层、多个卷积层和一个输出层组成。卷积层是最重

发表于 02-23 20:11

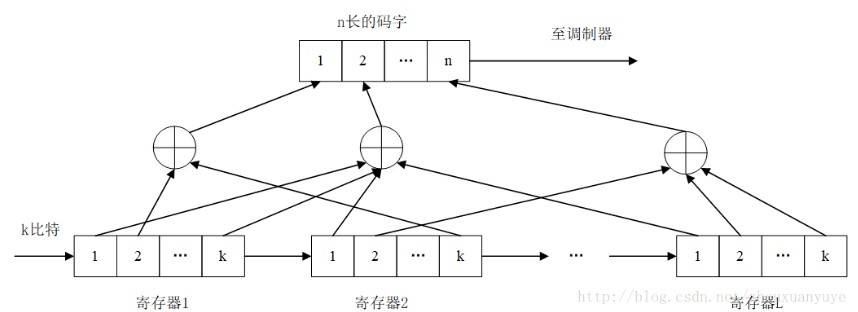

复杂性相同的条件下,卷积码的性能优于分组码。但卷积码没有分组码那样严密的数学结构和数学分析手段,目前大多是通过计算机进行好码的搜索。什么是卷积码的约束长度?二进制卷积码编码器的形式如下图所示,它包括一个由

发表于 05-30 16:06

实验二 FFT与DFT计算时间的比较及圆周卷积代替线性卷积的有效性实验:一 实验目的1:掌握FFT基2时间(或基2频率)抽选法,理解其提高减少乘法运算次数提高运算速度的原理。2:掌握FFT圆周卷积

发表于 12-29 21:52

本帖最后由 zgzzlt 于 2012-8-16 14:23 编辑

《C语言深度剖析》【超经典书籍】

发表于 08-02 08:59

C语言深度剖析——一本关于C语言学习的教程,里面包含C语言编写规范,各种变量指针用法等。以含金量勇敢挑战国内外同类书籍

发表于 08-14 11:36

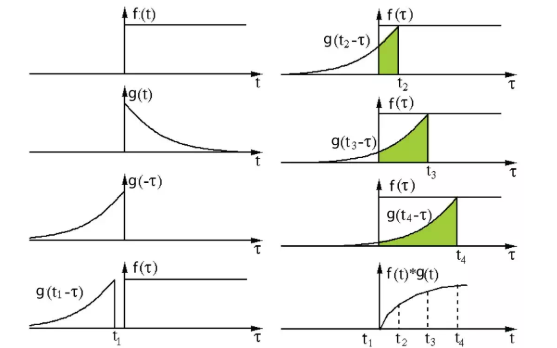

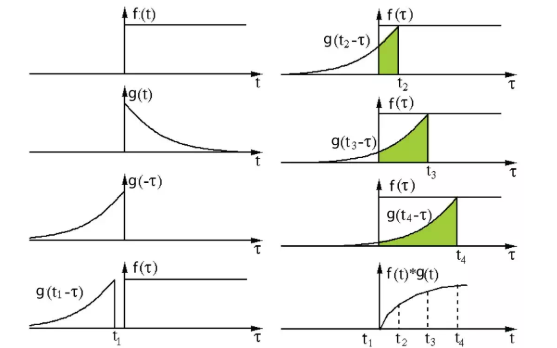

y(n) =x(n)* h(n)上式的运算关系称为卷积运算,式中 代表两个序列卷积运算。两个序列的卷积是一个序列与另一个序列反褶后逐次移位乘积之和,故称为离散卷积,也称两序列的线性卷积。其计算的过程

发表于 10-31 22:29

定义一个函数文件,功能是采用重叠相加法完成无限长序列与有限长序列的线性卷积,然后用该函数文件计算序列x[k]=2k+1,0≤k≤18与序列h[k]={1,2,3,4;k=0,1,2,3}的线性卷积结果。

发表于 11-29 13:36

基于Labview的圆周卷积演示系统应该怎么设计就是操作页面怎么设计急!写开题

发表于 03-21 14:28

老师给的sconv函数只能周计算定义在正半轴的函数卷积,当计算在负半轴的函数时,就会出现不一致的情况,请问如何解决?function [y,k]=sconv(f,h,nf,nh,p);y=conv

发表于 05-10 21:15

陈正冲编写的《C语言深度剖析》,挺经典,刚来论坛,多多指教~~

发表于 08-17 12:06

linux内核深度剖析,对于想学linux内核的人来说,绝对值得一看,另附有光盘资料。

发表于 01-15 21:25

` 本帖最后由 2703997762 于 2015-12-8 16:25 编辑

国嵌——嵌入式c语言深度剖析,百度云链接在附件里`

发表于 12-08 16:20

嵌入式网络那些事LwIP协议深度剖析与实战演练

发表于 06-12 13:43

检测与分割深度学习的发展及应用 报 告 人:季向阳 清华大学 报告摘要:物体检测与分割是图像处理与计算机视觉重要基础研究方向之一。首先介绍全卷积网络在语义分割与实例掩模研究方面的进展,之后介绍面向实例关联

发表于 03-22 17:16

打算用FPGA实现高维度(248维)定点矩阵乘法,开发板为赛灵思Virtex-VII,请问用部分IP核实现还是自己写性能更好? 此外,我的课题是FPGA实现高维度(248维)独立成分分析ICA,请问维度这么大FPGA能跑起来么?有什么建议吗?万分感激!

发表于 06-02 22:03

本帖最后由 炜君子 于 2017-7-24 19:05 编辑

做了一个简单的“卷积和相关分析模块”,当信号均为低频时,卷积、反卷积、自相关、互相关运算都很正常;但是当频率达到10^4级

发表于 07-24 19:05

卷积特性(卷积定理).ppt

发表于 10-03 23:09

卷积特性(卷积定理).zip

发表于 10-04 11:36

本帖最后由 lee_st 于 2018-4-3 09:43 编辑

嵌入式网络那些事LwIP协议深度剖析与实战演练

发表于 04-02 10:44

思维导图如下:发展历程DNN-定义和概念在卷积神经网络中,卷积操作和池化操作有机的堆叠在一起,一起组成了CNN的主干。同样是受到猕猴视网膜与视觉皮层之间多层网络的启发,深度神经网络架构架构应运而生,且

发表于 05-08 15:57

`前言卷积神经网络在深度学习领域是一个很重要的概念,是入门深度学习必须搞懂的内容。CNN图像识别的关键——卷积当我们给定一个"X"的图案,计算机怎么识别这个图案

发表于 10-17 10:15

FPGA 上实现卷积神经网络 (CNN)。CNN 是一类深度神经网络,在处理大规模图像识别任务以及与机器学习类似的其他问题方面已大获成功。在当前案例中,针对在 FPGA 上实现 CNN 做一个可行性研究

发表于 06-19 07:24

CNN) 其通过计算卷积描述向量(descriptor)的外积来考察不同维度之间的交互关系。由于描述向量的不同维度对应卷积特征的不同通道,而不同通道提取了不同的语义特征,因此,通过双线性操作,可以同时

发表于 07-21 13:00

有没有转让 嵌入式网络那些事lwip协议深度剖析与实战演练 这本书的呀?现在除了某宝能买到这本书(八成是盗版),其他网站都买不到了,我特别想看看这本书,求各位大神帮助~~

发表于 08-18 21:19

《深度学习工程师-吴恩达》03卷积神经网络—深度卷积网络:实例探究 学习总结

发表于 05-22 17:15

Winograd,GEMM算法综述(CNN中高效卷积实现)(上)

发表于 06-04 09:06

【深度学习】卷积神经网络CNN

发表于 06-14 18:55

解析深度学习:卷积神经网络原理与视觉实践

发表于 06-14 22:21

本帖最后由 liujing1232 于 2020-12-10 17:02 编辑

1 DPU Xilinx® 深度学习处理器单元 (DPU) 是一个专门用于卷积神经网络的可编程引擎。该单元包含

发表于 12-10 15:23

的GraphSAGE算法,其内层循环的聚合以及合并(包含卷积)等两个操作占据了算法的绝大部分计算和存储器访问。通过研究,我们得到这两个步骤的特征如下:表2:GNN算法中聚合与合并操作对比可以看出,聚合

发表于 07-07 08:00

我们可以对神经网络架构进行优化,使之适配微控制器的内存和计算限制范围,并且不会影响精度。我们将在本文中解释和探讨深度可分离卷积神经网络在 Cortex-M 处理器上实现关键词识别的潜力。关键词识别

发表于 07-26 09:46

示例.0042(1.0)关键词:阵列-阵列操作,图像滤波器,高斯平滑处理 1. 描述■ 该案例示范了两个2维数值数据数组的卷积。■ 在实例中,卷积运算被用于一个特殊的图像滤波器,实现高斯平滑滤波操作

发表于 11-30 10:15

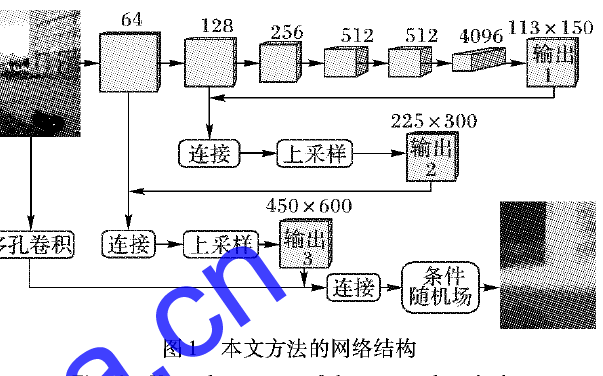

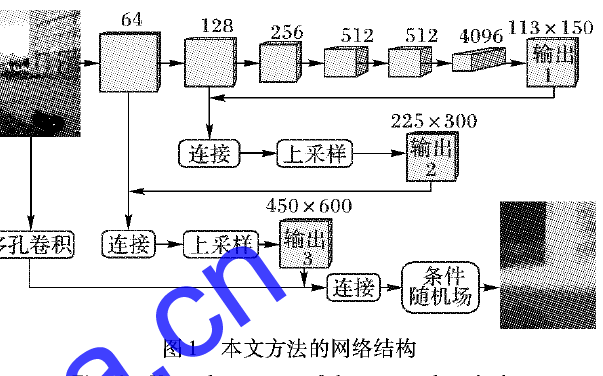

。基于此作者引入反卷积(deconvolution)操作,对缩小后的特征进行上采样,恢复原始图像大小。跳跃结构:语义分割包括语义识别和目标定位。卷积网络的高层特征图可以有效的反应语义信息,而低层特征图

发表于 12-28 11:03

C语言深度剖析

发表于 12-30 09:20

•0次下载

通过程序设计来实现连续时间系统卷积的计算,更深刻的理解卷积的意义。

发表于 05-23 18:21

•1次下载

为了在不增加较多计算量的前提下,提高卷积网络模型用于图像分类的正确率,提出了一种基于复杂网络模型描述的图像深度卷积分类方法。首先,对图像进行复杂网络描述,得到不同阈值下的复杂网络模型度矩阵;然后,在

发表于 12-24 16:40

•4次下载

针对在传统机器学习方法下单幅图像深度估计效果差、深度值获取不准确的问题,提出了一种基于多孔卷积神经网络(ACNN)的深度估计模型。首先,利用卷积神经网络(CNN)逐层提取原始图像的特征图;其次,利用

发表于 10-30 14:58

•10次下载

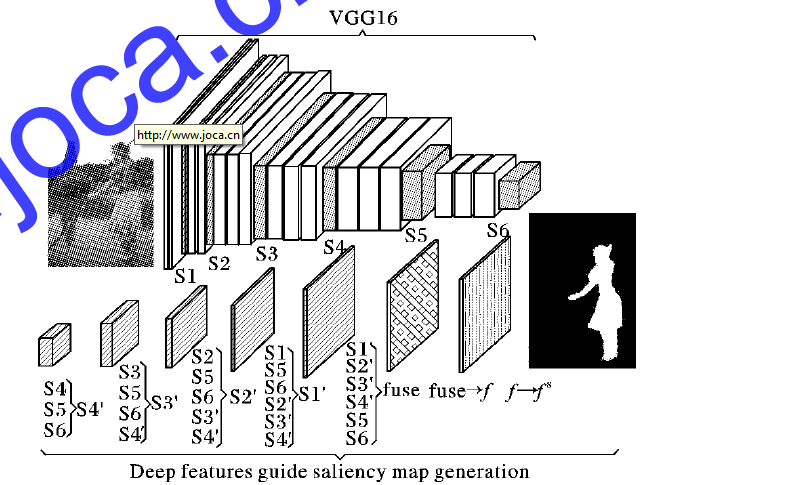

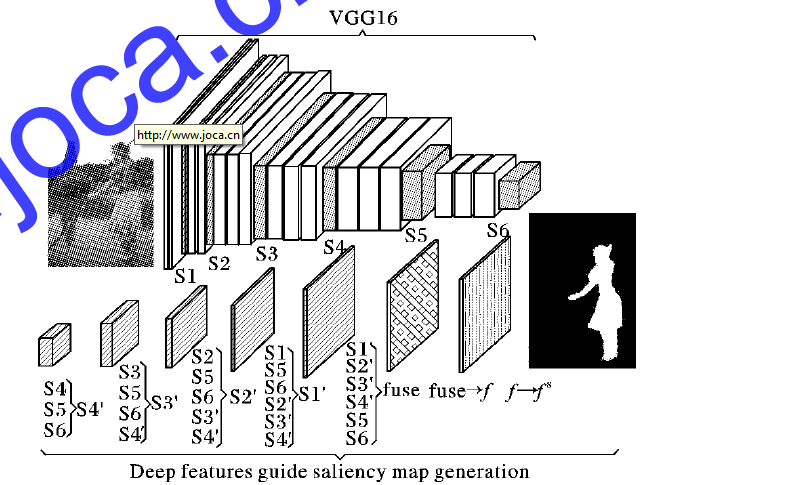

针对目前基于深度卷积神经网络的显著性检测算法存在对复杂场景图像目标检测不完整、背景噪声多的问题,提出一种深度特征导向显著性检测算法。该算法是基于现有底层特征与深度卷积特征融合模型(ELD)的改进

发表于 11-15 17:56

•10次下载

针对在传统机器学习方法下单幅图像深度估计效果差、深度值获取不准确的问题,提出了一种基于多孔卷积神经网络(ACNN)的深度估计模型。首先,利用卷积神经网络(CNN)逐层提取原始图像的特征图;其次,利用

发表于 09-29 16:20

•5次下载

采用卷积神经网络对单目图像的深度进行估计时,存在深度信息不精确、边缘模糊以及细节缺失等问题。为此,提出一种多层级特征融合结构的深度卷积网络。该网络采用端到端的编-解码器结构,编码器

发表于 03-16 09:21

•7次下载

)釆用深度可分离卷积代替TCN中的普通卷积,先通过通道卷积对普通卷积在空间维度上进行分离,以增加网络宽度并扩大特征提取范围,再利用逐点卷积降低普通卷积操作的计算复杂度。实验结果表明,与TCN网络相比L-TCN在保证时间序

发表于 03-22 16:04

•6次下载

深度学习是机器学习和人工智能研究的最新趋势,作为一个十余年来快速发展的崭新领域,越来越受到研究者的关注。卷积神经网络(CNN)模型是深度学习模型中最重要的一种经典结构,其性能在近年来深度学习任务上

发表于 04-02 15:29

•18次下载

冗余,以获取更高的重建质量与加速因子,提出了一种深度迭代卷积神经网络( DICNN)。在每次迭代中,首先使用双向卷积模块(BDC)探索相邻切片间的数据冗余,然后用ΣD卷积模块(RNEI)进一步探索单幅MRI切片内部的数据冗余。在单线圈的脑部MRI数据

发表于 04-07 10:21

•13次下载

卷积在统计学、信号处理、图像处理、深度学习等领堿有着广泛的应用,且起到了至关重要的作用。在深度神经网络使用卷积运算对输入信息进行特征提取的方法是实现神经网络的基础计算单元之一。如何优化卷积的运算速度

发表于 04-13 14:33

•1次下载

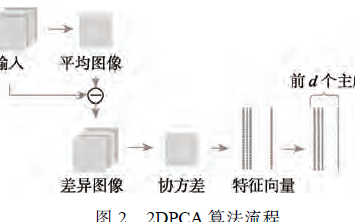

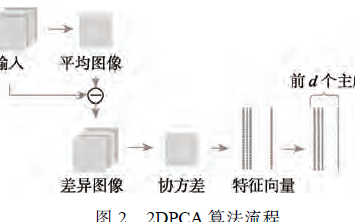

由于半导体制造过程的高度复杂性和动态性,各种过程故障通常导致晶圆表面出现各种缺陷模式。为了有效地识别晶圆表面缺陷模式从而及时地诊断和控制故障源,提出一种深度神经网络模型——二维主成分分析卷积自编

发表于 04-22 11:31

•19次下载

针对提取图表征用于图分类过程中的结构信息提取过程的问题,提出了一种图卷积神经网络与胶囊网络融合的图分类模型。首先,利用图卷积神经网络处理图中的节点信息,迭代以后得到节点表征,表征中蕴含着该节点的子树

发表于 05-07 15:17

•9次下载

随着深度学习的发展,卷积神经网络作为其重要算法被广泛应用到计算机视觉、自然语言处理及语音处理等各个领域,并取得了比传统算法更为优秀的成绩。但是,卷积神经网络结构复杂,参数量和计算量巨大,使得很多算法

发表于 05-17 15:44

•4次下载

神威·太湖之光深度学习库中的并行卷积算法存在批量受限的问题,且传统gemm卷积算法在其硬件架构上效率较低。基于申威异构众核处理器,提出一种无批量限制的通用并行卷积算法。结合异步DMA访存操作和从核间

发表于 05-19 11:45

•1次下载

随着深度学习的不断发展,卷积神经网络(CNN)在目标检测与图像分类中受到研究者的广泛关注。CNN从 Lenet5网络发展到深度残差网络,其层数不断增加。基于神经网络中“深度”的含义,在确保感受野相同

发表于 05-19 16:11

•3次下载

的大小,保证分块数量相等,然后对分块的图像进行深度卷积池化増强,増强方法为最大值増强,并对噪声进行最大值池化操作,然后将两者进行对抗判别,运用交叉熵误差对价值函数进行评估,求解花朵图像识别与分类的结果。文中分

发表于 05-28 16:51

•5次下载

剖析环路设计相关计算

发表于 09-24 09:36

•7次下载

本文首发于 GiantPandaCV :深入理解神经网络中的反(转置)卷积作者:梁德澎本文主要是把之前在知乎上的回答:反卷积和上采样+卷积的区别...

发表于 02-07 11:17

•0次下载

汽车新热点:T-box系统解决方案深度剖析之紧急呼叫单元

发表于 11-01 08:26

•0次下载

汽车新热点:T-BOX系统解决方案深度剖析之接口

发表于 11-01 08:26

•3次下载

汽车新热点: T-BOX系统解决方案深度剖析之充放电管理

发表于 11-01 08:26

•2次下载

汽车新热点: T-BOX系统解决方案深度剖析之电源轨

发表于 11-01 08:26

•0次下载

日前,盛传LED行业的寒冬即将到来,新一轮的大洗牌将重新整合LED业,本文就浩博光电停产出发深度剖析LED行业现状,指出LED业该往哪走。

发表于 11-30 10:23

•907次阅读

,自然语言处理,推荐算法,图像识别等广泛的应用领域。 FPGA云服务器提供了基于FPGA的深度卷积神经网络加速服务,单卡提供约3TOPs的定点计算能力,支持典型深度卷积网络算子,如卷积、逆卷积、池化、拼接、切割等。有效加速典型网络结构如VggNet、GoogLe

发表于 11-15 16:56

•602次阅读

) demystified》的文章,对用于图像识别和分类的卷积神经网络架构作了深度揭秘;作者在文中还作了通盘演示,期望对 CNN 的工作机制有一个深入的剖析。 引言 先坦白地说,有一段时间我无法真正理解深度学习。我查看相关研究论文和文章,感觉深度学习异常复杂。

发表于 11-15 16:58

•7361次阅读

到只有有限硬件资源的嵌入式系统上。 为了解决这个限制,可以使用深度压缩来显著地减少神经网络所需要的计算和存储需求。例如对于具有全连接层的卷积神经网络(如Alexnet和VGGnet),深度压缩可以将模型大小减少35到49倍。

发表于 11-16 13:11

•1367次阅读

取反使得h(i)以纵轴为中心翻转180度,所以这种相乘后求和的计算法称为卷积和,简称卷积。 另外,n是使h(-i)位移的量,不同的n对应不同的卷积结果。如果卷积的变量是函数x(t)和h(t),则卷积的计算变为 , 其中p是积分变量,积分也是求和,t是使函

发表于 11-28 17:54

•13.6w次阅读

理解传统的计算机视觉实际上真的有助于你更好的使用深度学习。例如,计算机视觉中最常见的神经网络是卷积神经网络。但是什么是卷积?它实际上是一种广泛使用的图像处理技术(例如Sobel边缘检测)。了解卷积有助于了解神经网络的内在机制,在解决问题时,它可以帮助你设计和调整模型。

![的头像]() 发表于

发表于 04-02 10:37

•5568次阅读

卷积码是一种差错控制编码,由P.Elias于1955年发明。因为数据与二进制多项式滑动相关故称卷积码。

发表于 08-20 15:11

•1.6w次阅读

网络的前向传播和反向传播过程讲清楚,以及如何使用 numpy 和 tensorflow 实现卷积网络。然后会从深度卷积网络的发展历程出发,对主要的经典深度网络进行深度剖析,对计算机视觉的三大核心任务

![的头像]() 发表于

发表于 10-08 12:56

•2135次阅读

在信号处理、图像处理和其它工程/科学领域,卷积都是一种使用广泛的技术。在深度学习领域,卷积神经网络(CNN)这种模型架构就得名于这种技术。但是,深度学习领域的卷积本质上是信号/图像处理领域内的互相关(cross-correlation)。这两种操作之间存在细微的差别。

![的头像]() 发表于

发表于 02-26 10:01

•2717次阅读

有些消息来源使用名称deconvolution,这是不合适的,因为它不是解卷积。为了使事情更糟,确实存在解卷积,但它们在深度学习领域并不常见。实际的反卷积会使卷积过程恢复。想象一下,将图像输入到单个

![的头像]() 发表于

发表于 04-19 16:48

•3127次阅读

的核心操作时卷积,GNN也是。CNN计算二维矩阵的卷积,GNN计算图的卷积。那么我们定义好图的傅里叶变换和图的卷积就可以了,其媒介就是图的拉普拉斯矩阵。

![的头像]() 发表于

发表于 06-08 17:13

•2803次阅读

卷积神经网络是一类包含卷积计算且具有深度结构的前馈神经网络,是深度学习的代表算法之一 。卷积神经网络具有表征学习能力,能够按其阶层结构对输入信息进行平移不变分类,因此也被称为“平移不变人工神经网络” 。

![的头像]() 发表于

发表于 11-25 07:04

•1783次阅读

卷积神经网络仿造生物的视知觉(visual perception)机制构建,可以进行监督学习和非监督学习,其隐含层内的卷积核参数共享和层间连接的稀疏性使得卷积神经网络能够以较小的计算量对格点化

![的头像]() 发表于

发表于 11-14 07:10

•1371次阅读

卷积神经网络作为深度学习的典型网络,在图像处理和计算机视觉等多个领域都取得了很好的效果。

![的头像]() 发表于

发表于 01-01 17:30

•7981次阅读

图像卷积操作(convolution),或称为核操作(kernel),是进行图像处理的一种常用手段,

![的头像]() 发表于

发表于 03-13 16:44

•2581次阅读

这篇文章对转置卷积(反卷积)有着很好的解释,这里将其翻译为中文,以飨国人。

![的头像]() 发表于

发表于 09-03 09:39

•4078次阅读

科技大咖公认的第三代计算平台XR眼镜随着5G的大规模建设与商用化,将加快其走向消费者市场的步伐,逐步从技术竞争阶段进入到以改善用户体验为核心的竞争阶段。XR眼镜的用户体验竞争具体体现在哪些方面?本文将从重量、操作系统、交互技术三个维度进行深度剖析。

![的头像]() 发表于

发表于 09-03 09:52

•6422次阅读

反卷积也称为转置卷积,如果用矩阵乘法实现卷积操作,将卷积核平铺为矩阵,则转置卷积在正向计算时左乘这个矩阵的转置WT,在反向传播时左乘W,与卷积操作刚好相反,需要注意的是,反卷积不是卷积的逆运算。

![的头像]() 发表于

发表于 09-24 13:04

•2043次阅读

在本文中,我尽量使用简单明了的方式向大家解释深度学习中常用的几种卷积,希望能够帮助你建立学习体系,并为你的研究提供参考。 Convolution VS Cross-correlation 卷积是一项

![的头像]() 发表于

发表于 10-08 23:59

•5503次阅读

激进,这些领域恐怕比卷积更深奥,所以只需简略看看即可。以下是正文: 卷积现在可能是深度学习中最重要的概念。正是靠着卷积和卷积神经网络,深度学习才超越了几乎其他所有的机器学习手段。但卷积为什么如此强大?它的原

![的头像]() 发表于

发表于 10-17 10:06

•2200次阅读

概述 深度学习中CNN网络是核心,对CNN网络来说卷积层与池化层的计算至关重要,不同的步长、填充方式、卷积核大小、

![的头像]() 发表于

发表于 04-06 15:13

•2123次阅读

,甚至是该领域接受过培训的科学家,都不知道它们究竟是如何运作的。 大量有关深度学习的成功或失败事例给我们上了宝贵的一课,教会我们正确处理数据。在这篇文章中,我们将深入剖析深度学习的潜力,深度学习与经典计算机

![的头像]() 发表于

发表于 04-22 10:45

•1833次阅读

相信每一位录友都接触过时间复杂度,但又对时间复杂度的认识处于一种朦胧的状态,所以是时候对时间复杂度来一个深度的剖析了。

![的头像]() 发表于

发表于 03-18 10:18

•994次阅读

卷积神经网络(CNN)是一种特殊类型的神经网络,在图像上表现特别出色。卷积神经网络由Yan LeCun在1998年提出,可以识别给定输入图像中存在的数字。

发表于 09-21 10:12

•434次阅读

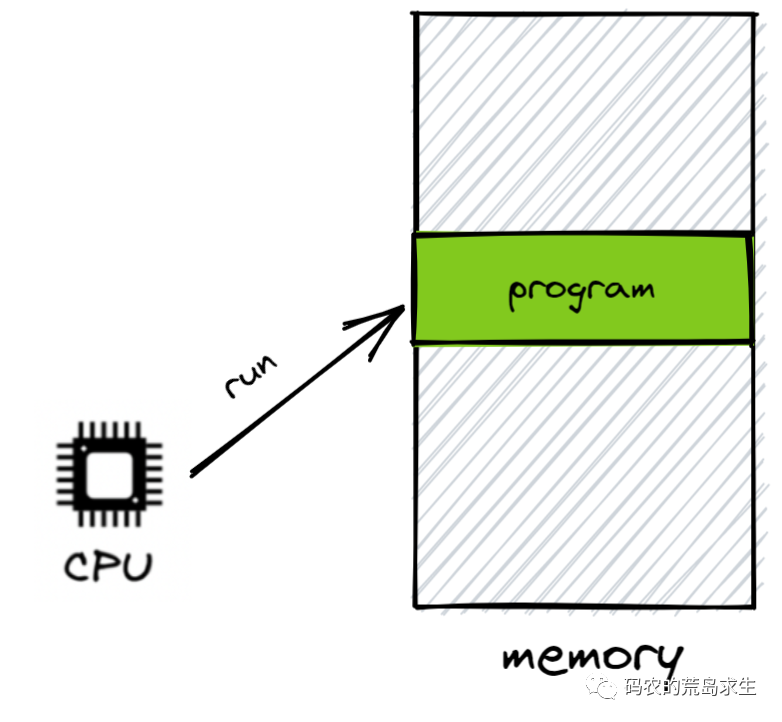

今天我们从三个方面来简单聊聊为什么计算机需要操作系统这个话题。

##### **资源分配器**

如果你的CPU上只需要运行一个程序,那么你的确不需要操作系统。

![的头像]() 发表于

发表于 02-15 11:50

•152次阅读

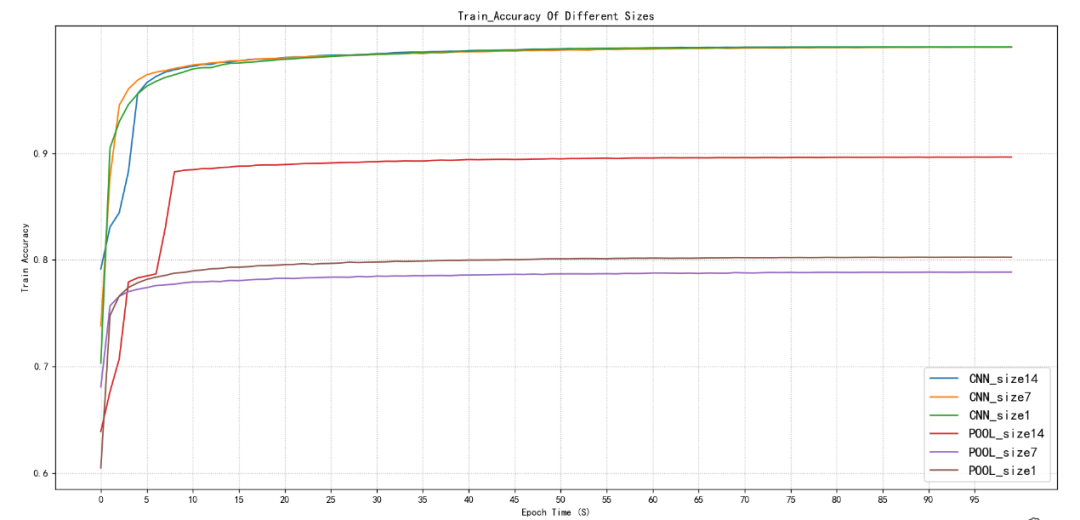

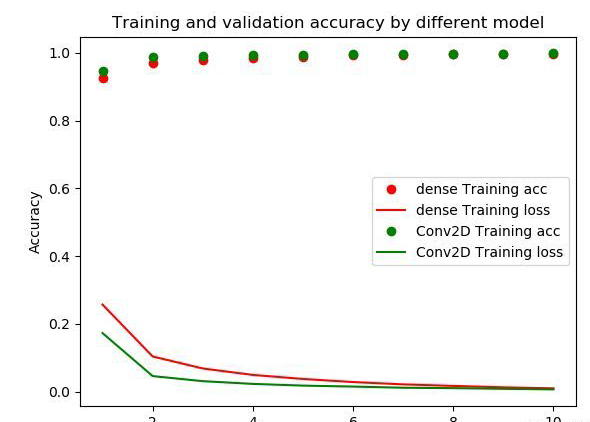

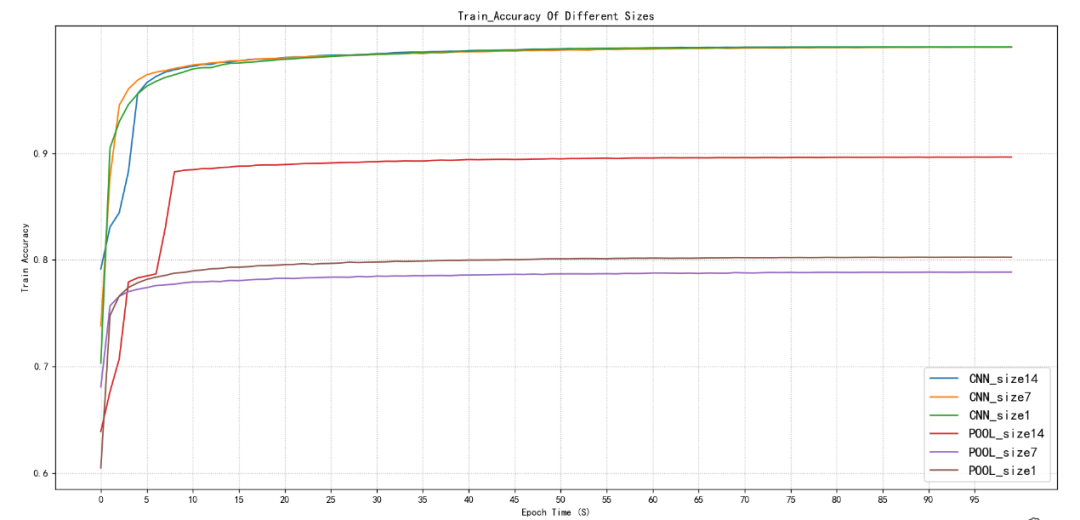

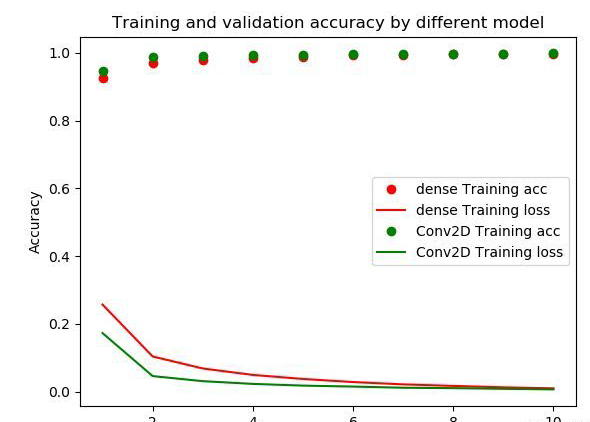

在学习深度学习中卷积网络过程中,有卷积层,池化层,全连接层等等,其中卷积层与池化层均可以对特征图降维,本次实验针对控制其他层次一致的情况下,使用卷积降维与池化降维进行对比分析,主要是看两种降维方式对精度的影响以,以及损失值的大小。与此同时还可以探究不同维度下对精度是否有影响。

![的头像]() 发表于

发表于 02-17 14:58

•289次阅读

卷积神经网络是一类包含卷积计算且具有深度结构的前馈神经网络,是深度学习。卷积神经网络具有表征学习能力,能够按其阶层结构对输入信息进行平移不变分类,因此也被称为“平移不变人工神经网络。

![的头像]() 发表于

发表于 02-21 15:05

•116次阅读

深度剖析卷积操作的维度计算

深度剖析卷积操作的维度计算 0

0

评论